A entropia é uma grandeza termodinâmica associada à irreversibilidade dos estados de um sistema físico. É comumente associada ao grau de “desordem” ou “aleatoriedade” de um sistema. De acordo com um dos enunciados da 2ª Lei da Termodinâmica:

“Em um sistema termicamente isolado, a medida da entropia deve sempre aumentar com o tempo, até atingir o seu valor máximo.”

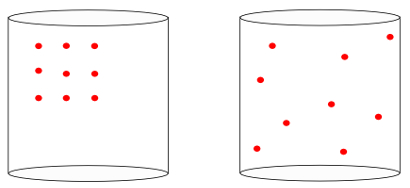

Em outras palavras, a entropia é capaz de medir o sentido da “seta do tempo” de um sistema. Quando vemos as imagens a seguir, sabemos intuitivamente que o estado inicial do sistema é o representado pela imagem da esquerda, de maior organização:

Olhando para a imagem anterior, sabemos que a configuração final mais provável é aquela na qual os átomos possuem velocidades em todas as direções, bem como posições aleatórias. É disso que a entropia trata: a multiplicidade de estados de um sistema deve sempre aumentar.

Tópicos deste artigo

Exemplos

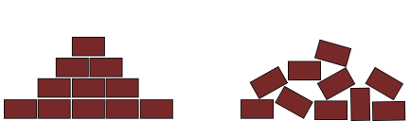

Qual das configurações abaixo é mais provável de ser observada para um arranjo de tijolos com o passar do tempo?

Na primeira configuração, a multiplicidade dos estados dos blocos é pequena: eles estão todos dispostos na direção horizontal, paralelamente uns aos outros. Com a passagem do tempo ou pela ação de algum agente, espera-se que sua configuração cresça em número de estados, favorecendo a segunda conformação, ilustrada na imagem à direita. Outros exemplos podem ser dados:

-

Quando um bloco de gelo é colocado em um recipiente com maior temperatura, sua temperatura aumenta até que se atinja o equilíbrio térmico. Nesse momento, o gelo pode fundir. Retirando-se calor novamente do bloco de gelo, que está agora no estado líquido, ele pode tornar-se sólido novamente, mas sua conformação não terá a mesma organização que apresentava anteriormente.

-

Ao abrirmos um frasco de perfume, o calor pode auxiliar na difusão de suas moléculas, espalhando o conteúdo do perfume por toda a extensão de uma sala. O contrário não pode ser esperado, já que a retirada de calor não promoveria a volta das moléculas para dentro do frasco.

Anuncie aqui

Definição matemática de Entropia

A definição matemática de entropia é dada pela razão da quantidade de calor (Q) transferida entre duas porções de um sistema termicamente isolado, em Joules (J), por sua temperatura absoluta, em Kelvin (K):

ΔS = Entropia (J/K)

ΔQ = Quantidade de calor (J)

T = Temperatura absoluta (K)

A definição apresentada acima é válida para processos isotérmicos, ou seja, em que haja trocas de calor tão pequenas (ou lentas) que não sejam capazes de mudar a temperatura do sistema. A definição de entropia é, portanto, infinitesimal (parte infinitamente pequena).

Podemos ainda entender o conceito de entropia da seguinte forma: sendo um sistema formado por duas porções de um mesmo gás, em diferentes temperaturas, é possível extrair alguma quantidade de trabalho dele movendo algum pistão ou manivela, por exemplo. Entretanto, com o passar do tempo, as partes desse gás tenderão ao equilíbrio térmico. Não havendo mais diferença de temperatura, mesmo estando toda a energia ali presente, não será possível extrair qualquer trabalho útil dele.

Por Rafael Helerbrock

Graduado em Física